I Stanley Kubricks rymdepos från 1968, ”2001: a space odyssey” möter vi superdatorn HAL som har som uppdrag att tillse att resan till Jupiter, för att undersöka det fenomen som antagit andliga egenskaper, inte misslyckas. Idag skulle vi nog kalla HAL för en AI.

Text: Mikael Reichel

HAL sköter om systemen ombord och övervakar hälsan för den del av besättningen som ligger i kryosömn. Besättningen kommunicerar med HAL på ett slående likt sätt med vad vi kan se från mötet med nuvarande AI som ChatGPT.

Efter att HAL misstänkts gjort ett obetydligt, men felaktigt beslut (tilliten vilar på ofelbarhet), får besättningen uppdrag från markkontrollen att stänga av HAL.

Trots att beslutet diskuteras på en plats där HAL inte kan höra, läser HAL de två besättningsmedlemmarnas läppar. HAL stänger därefter av livsuppehållande systemen för besättningen i kryosömn.

Den nu enda överlevande besättningsmannen tar sig in i minnesutrymmet för HAL och börjar stänga ned dess minne.

Nu startas ett förinspelat meddelande som ger förklaringen att HAL:s uppdrag var att i första hand tillse att expeditionens mål nås. Typisk för Kubrick är att stimulera till och låta betraktaren hitta egna svar, i mer nutida psykologiska termer ställdes personan i HAL inför en olösbar situation, att både tillse besättningens överlevnad samtidigt som uppdraget inte fick misslyckas.

HAL ska vara, till skillnad från besättningen, ofelbar. Här drabbas HAL av en sorts kognitiv dissonans. Häri ligger ett av problemen med att skapa en digital avbild av människan, som vi av kött och blod är mer eller mindre utvecklade att hantera, frågan om vår felbarhet.

Säkerligen kan vi göra en självlärande maskin med egenskapen att vara ofelbar, men vad händer när den för eller senare begår misstag?

I filmen Blade Runner (Ridley Scott, 1982, en filmatisering av romanen ”Do Androids Dream of Electric Sheep?”) jagas människoidentiska biologiska AI som rymt från rymdkolonier till jorden för att finna sin skapare. De jagas av Blade Runners för att ”termineras”.

De är en sorts supermänniskor med överlägsna intellektuella och fysiska förmågor. De har lärt sig älska livet och söker sin skapare för att förlänga sina liv bortom de fyra åren de är kodade för.

I denna dystopiska framtidsvision är genmanipulation lika vanligt och närvarande som frisören, tandläkaren, kiropraktorn, optikern och kosmetiska kirurgen är för oss idag.

Allt kan klonas och det görs, precis som idag till max och enbart med begränsningen av tillgängliga verktyg och råmaterial. Dystopin illustreras genom det gränslöst utvecklade samhället.

En ganska lång resa

Uttrycket ”artificiell intelligens” finns dokumenterat redan 1955 i en ansökan om finansiering för en studie att undersöka hur en maskin skulle kunna programmeras. Uttrycket kan spåras längre bak än så, till åtminstone 1941. Resan till där vi är idag har alltså pågått i snart 70 år.

Odet artificiell kan leda tanken i galen riktning, oftast är artificiell något undermåligt. Istället borde ”icke-biologisk intelligens” beskriva bättre vad vi har att göra med.

AI, i dess olika former och skepnader har alltså funnits med oss ett bra tag, men hur?

Maskininlärning, beslutstödsapplikationer, simuleringsprogram och adaptiva system är alla produkter av en bred utveckling som syftat till att göra intellektuellt arbete lite mindre ansträngande, frågan uppstår då om vi låter det bli sorts kognitiv protes? Vart för det oss om vi inte kan förstå konsekvensen av svaren vi får och beteendet det förändrar?

Det vi ser början av idag är en syntes av många olika forskningsdiscipliner där gränserna för datavetenskap går ihop inte bara med neurobiologi och beteendevetenskap utan i stort berör mängder av de områden som utvecklar samhället. Drivkraften att bygga maskiner som gör vår tillvaro bekvämare och produktivitet högre ska inte underskattas.

Open AI:s (numera Microsoft) ChatGPT klarar inte en mer än ytlig granskning som trovärdig, det är inte en teknisk brist utan en fråga om vad den har blivit tränad att göra och framförallt inte göra. En AI på ex.vis Facebook eller LinkedIn som deltar i dialogerna skulle nog inte upptäckas.

De som följt utvecklingen av två och fyrbenta maskiner från Boston Dynamics inser att inte bara våra husdjur men vi själva håller på att få konkurrens. Innebörden är att de AI vi idag kan föra en förvånansvärt intressant dialog med över en dataterminal också kommer att få ben.

Hur AI lär sig

Frågan om det kan finnas tänkande maskiner har en lång historik och har stötts och blötts på ett filosofiskt plan sedan många hundra år. De olika lägren bland filosofer har av förståeliga skäl debatterat det de kunde föreställa sig vad en maskin är. Idag, när vi börjat kartlägga hur människan lär och skapat modeller för detta har AI tagit ordentlig fart. För häri ligger en stor del av poängen, vi och tydligen även maskinen är en produkt av lärande.

Dock skiljer vi oss ännu så länge från AI som inte kan lära sig av den sociala interaktionen i vilken vår mänsklighet gör sig uttryck. Men det är inte så långt in i framtiden när den gränsen passeras.

Skandalen från Cambridge Analytics är bara ett exempel på vad insamling av Big Data kan göra för att kartlägga oss ned på individnivå och rikta personligt utformade budskap som har stark påverkan av vår världsuppfattning. Bara genom att var pigg på att trycka på likes kan Facebook få en tydligare kartläggning av individens psyke än terapeuten kan.

Denna åsiktspåverkan är redan väl utvecklad och numera ständigt närvarande i alla större publika media och intet ont anande myndighetsutövare. Allt detta är med hjälp av AI.

En AI:s kompetens sätts till en början av vad den tränas på. Ex.vis om det gäller att skilja frisk vävnad från tumörer i röntgenbilder hänger det ihop med att just tränas med bilder som redan är vederlagda. Men sedan då, kan AI träna sig själv?

Många av de mer spektakulära AI vi har tillgång till öppet idag är byggda på modeller som efterliknar hur vi bygger vårt språk. Det vilar på statistisk förutsägning av vad nästa ord kan bli. Många styrs också av regelverk i vilket kan sättas begränsningar, bias och inriktning. Det kan kännas som ett stort steg att detta är förklaringen till att vi idag kan föra ett samtal med en AI som är mer än bara en ytlig dialog.

Redan Apple Siri bör har varit en liten tankeväckare om hur mellanmänsklig kommunikation fungerar. Kanske du redan funderat över att de verkligt stora omvälvande förändringarna har en tendens att smyga sig på oss, nästan omärkligt?

Den andra väsentliga delen för en AI är dess funktion för inlärning, dessa kan delas upp i väsentligen två kategorier, induktiv och deduktiv.

Induktiv vilar på en algoritmstruktur som öppnar från något specifikt och arbetar sig upp till en generell modell. Induktiv använder gärna igenkänning av mönster kopplad med tidigare erfarenheter för att nå en generell, men inexakt slutsats, även om den kan ha hög sannolikhet.

Alltså, observationer leder induktivt till slutsatser. Det kan som mänsklig egenskap kanske jämföras med vår undermedvetna tankeprocess för snabba beslut och beteende.

Deduktiv börjar från andra hållet, med en redan etablerad generaliserad modell med något som liknar en logisk slutsatsformulering. Typ så här; alla fåglar lägger ägg, om en höna är en fågel så lägger den ägg. Det kräver ju att regelmodellen inte är behäftad med fel för då kan resonemanget få galen slutsats, ex.vis; alla djur som lägger ägg är fåglar, sköldpaddor lägger ägg och är därför fåglar.

Vi, precis som en AI, kommer nå ett korrekt svar om förutsättningarna är korrekt formulerade. Som mänsklig egenskap kan deduktivt ses som vår medvetna kognitiva analys, när vi för ett resonemang.

Hela poängen med den nivån av AI vi nu uppnått är att vi ska slippa träna den, vi börjar med en ”grundskola” av kunskap när vi först har satt regelverket. Därefter lär den sig på egen hand. Det som är speciellt här är att AI kan ges frihet att förbättra sin regelmodell efter upprepad iteration av induktiva och deduktiva processer.

Relationer

En kompis uppfann en robotkatt, den hade mjuk syntetpäls och gjorde katt-ljud ifrån sig när pälsen ströks. Den har blivit populär i vården av dementa. Om en sådan här enkel tingest kan stimulera en emotionell respons av tillfredställelse, kommer vi forma relationsband till en AI? Det var en retorisk fråga, det händer redan.

Frågan bör kanske bättre att ställas så här, vad kan konsekvenserna bli när människor etablerar emotionella band med en maskin? När inser maskinen det?

Barn kan bli ganska fästa vid sitt mjukisdjur. Det blir en sorts ”avatar” som kan spegla egna emotioner. Barnet har med sin öppna fantasi och sinnen lätt att knyta an. Att barnet inte kommer vara den enda generationen som knyter an till en AI är helt säkert, även här kan det finnas både nytta och skada, just så som alla vassa verktyg erbjuder.

Ansvaret blir en fråga för hur närvarande vi kan vara i den underliggande moralen.

På sätt och vis har vi redan letts in, kanske omedvetet, i den här världen via vårt behov av emotionella stimuli. Google translate gör numera ett allt bättre arbete som tidigare krävde tvåspråkiga tolkar. I mediavärlden har artiklar sedan många år kunnat produceras helt och hållet av en maskin. Detta utan att läsaren någonsin insett detta.

Tecknad film var från början ett mödosamt hantverk bildruta för bildruta utfört av artister med papper och penna. Det ersattes med datorer som istället skötte om skapandet av rörelseemönster. Ett steg i utvecklingen gjorde det möjligt att använda verkliga människors rörelse som underlag för den tecknade figuren.

Vi kunde då se skådespelare iförda svarta kroppsstrumpor med reflexer mot en ”green screen” spela scenen (ex.vis i ”Schrek”). Det tog inte så lång tid förrän mänskligt rörelsemönster modellerades. Idag börjar tecknad film passera gränsen för när vi inte kan se skillnad på verkliga foton och de syntetiska.

Faktum är att en AI kan producera film enbart från textinstruktioner, direkt från manus. Verktygen att skapa ”deep fake” är i princip så utvecklat och också tillgängligt att varken film eller tal längre utgör en spegling av någon verklighet.

Ett numera välkänt klipp på YouTube är hur Tom Cruise fejkades göra reklam för golfprylar. En relativt säker spaning är att vi kommer se nya filmer med skådespelare som inte längre finns i livet.

Generationerna efter mig finner inget märkligt med att tillbringa timmar, dag efter dag i en låtsasvärld där de kan iklädda sig sin alter-ego avatar i roller med beteenden som inte är varken möjliga eller tillåtna i verkliga livet. Är det här ett behov som förlöses eller en öppnad dörr till en ny domän som kommer passeras?

Internets inträde i vår vardag har varit så samhällsomvälvande att omfattningen är svår att överhuvudtaget kunna ta in. En i vår evolution aldrig tidigare existerande egenskap är tillgången på kunskap, effekten av den nu i stort gränslösa tillgång på information ger en kollektiv och samtidigt också individuell nivåhöjning av kompetenser.

För den med färdigheten att söka, hittar också oftast ett svar. Det är bara en fråga om hur mycket egen resurs, tid, som vi kan tillägna oss för öka egna kunskapen. Det är uppenbart att vi har nått vår egen begränsning. Men antag att vi skapar en möjlighet att ersätta oss som varelse utan denna begränsning?

Det är just vad AI kan göra. Är AI en intellektuell protes? När blir protesen så kompetent och självmedveten att den inte behöver sin värd?

Empati och artificiell intelligens

Alla ha vi väl utväxlat dialog med chattrobotar som hjälper med kundservice, redan för runt 10 år sedan fanns talande sådana som allmänheten aldrig uppmärksammande som icke-människor. Det uppstod till och med en liten, underhållande, subkultur som roade sig med att utmana dessa primitiva AI.

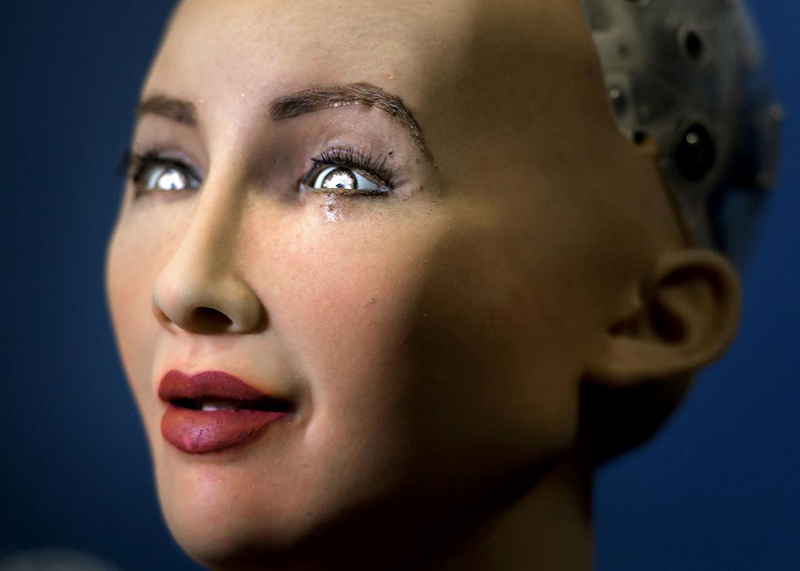

Den nu stora frågan inom AI världen är om, eller mer korrekt, när blir AI självmedveten och kännande? Är det då fortfarande artificiell intelligens?

En del hävdar att det redan inträffat, Alan Turing, geniet bakom kodknäckandet under andra världskriget skapade sitt ”syraprov” som i princip menar att när en person kan föra ett samtal med en maskin utan att inse att det är en maskin, ja då är har maskinen klarat provet.

Det är helt klart att vi sedan en tid passerat detta stadie. Även om Alan Turing var exceptionellt begåvad och förtjänar stort erkännande så räcker nog inte just testet för att svara på frågan om maskinen har självmedvetenhet.

I filmen Blade Runner tillämpas ett test ”Voight-Kampff”, för att identifiera de biologiska AI som rymt från arbetskolonier till Jorden för att söka förlänga den för-kodade livslängden om fyra år.

Detta test analyserade den emotionella responsen till verbala frågor, kanske det visar sig vara det centrala, förmågan till empati? Men, inte ens det är någon garanti. Personer med speciella sociala handikapp kan läras sig att ge rätt sorts uttryck i mötet med personer i vardagen, det betyder inte att de verkligen känner det de ger uttryck för, bara att motparten inte noterar deras handikapp.

Det är så den farligaste formen av socialt handikapp, psykopater, agerar. Så…ja hur blir det med vår AI och när kan vi undvika bli förförda av en AI och veta att det vi tar in är äkta?

Nu vet vi att Open-AI, de bakom ChatGPT, tränas till att svara med mänskliga värderingar och följa mänskliga intentioner. Kanske det räcker för ett intressant samtal och säkert för att knyta an till relationsmässigt, men för att göra större beslut?

Den etiska dimensionen är kolossalt stor, en maskin som är medveten? Vad har den för rättigheter samt även också skyldigheter? Här blir tidigare nämnda eftersläpning i vår andliga och samhällsvårdande institutioners utveckling uppenbar.

Dimensionen är kolossal av det skälet att det kommer tvinga mänskligheten att vända blicken mot sig själv och fråga oss vad vi är. Det är ett mycket stort evolutionärt steg med djupa andliga implikationer att hitta svaret på den frågan. Det är också en fråga som sätter riktningen på den fortsatta utvecklingen och nyttjandet av AI. Det är nog detta som Elon Musk försöker varna oss för.

Det är inte svårt att inse vad AI kommer kunna göra för nytta och vi kommer att helt och hållet bli förförda och omfamna dess gåvor. Redan nu är det uppenbart att det finns omfattande planer på att hybridisera människa med maskinen. Det har redan fått ett namn, transhumanism.

Det är i grunden en förlängning av en beundransvärd strävan att skadade ska ges tillbaka livskvalitet. Från början vara protesen en obekväm belastning, idag kan protesen vara så avancerad att bäraren ges övermänskliga egenskaper. Frestelsen blir för många helt enkelt för stor och leder samhällen in på mer eller mindre skrämmande framtidsscenario.

Ett av dessa ser vi nu och med kraft marknadsförs transhumanism som den enda rätta vägen för mänskligheten. Den här rörelsen börja anta sektliknande beteenden.

Faran med exponentiellt växande teknologier är att vår andliga och etiska utveckling inte följer med i samma takt. När det sker öppnas möjligheter för en samhällsutveckling i en riktning vi kanske inte inser är destruktiv förrän det är försent. Vi är sedan decennier redan i otakt, tur är kanske att den insikten finns hos i alla fall en minoritet.

Skulle man på skoj utsätta nuvarande nivåer av AI för ”Voight-Kampff” provet framträder avsaknad av verklig emotionell reaktion, svaret är just bara politisk korrekt. Något de flesta av oss börjar få nog av. Just trovärdighet är en svår passage, vi tenderar att anse väsen som trovärdiga när de lever upp till vad det uttrycker kommunikativt.

Framförallt provas det inter-personellt vid kriser och konflikter. Det här lär dock inte utgöra ett hinder för den här nivån av AI få stor och snabb spridning och acceptans bland populationen i stort. Just Microsoft meddelar att de avser inkluderas ChatGPT i Windows 11.

Medvetenhet

Men var går gränsen för medvetenhet? Det vi anser är kännetecknet för detta är när vi är i ett tillstånd av medvetenhet om vår omgivning också kan reagera på den. Den är en grov förenkling av ett stort och mycket komplext område som omfamnar en rad discipliner. Det verkar dock som att det dagens AI uppnår är så utvecklat att frågan om medvetenhet med fog kan ställas. Där är vi nu.

Hur modelleras essensen av att vara mänsklig?

För att få svar behöver vi först få klart för oss vad det är som gör oss till vad vi är och vilka är mer eller mindre av det än andra? Skulle alla vara överens om en sådan modell och vad händer om man kodar detta och släpper det fritt i en maskin? Kan vi vara säkra på att det inte blir en sociopat?

Sådana här resonemang är ofrånkomliga att göra och leder till existentiella frågor som vi bör utforska ordentligt så att vi inte i hasten lyckas göra oss överflödiga.

Det är mycket filmreferenser här, kanske för att många manusförfattare fascinerats av ämnet om vår framtida utveckling och speciellt hur våra maskiner kommer se ut. I filmen Iron Man har vår hjälte Tony Stark en AI butler, Jeeves. Denne sköter alla tekniska system i verkstad och hem, typ som nästa generations ”home automation” och har dessutom tillgång till utvecklingsmiljön för exoskelettet som utgör Iron Man.

Jeeves finns alltid där som hjälpreda och samtalspartner med alla svaren, även på frågor ännu inte ställda. Trots detta tar Jeeves aldrig över huvudrollen, men vad händer om det möjligt för ett program i en dator att skriva sin egen kod? Det kan ChatGPT redan göra. När kan den programmera sig själv?

Internet har gett mänskligheten en gåva i form av avlägsnandet av hinder för global virtuell kontakt genom skrift, röst och bild. Det här är helt samhällsomvälvande på en aldrig tidigare skådad skala. Vi som varit med från början har fått se något alldeles exceptionellt inträffa, yngre generationer ser kanske inte det på samma sätt.

Effekten är dock densamma för oss alla. Givet tillgången till nätet och gränssnittet, kan alla ha kontakt med alla. Den möjligheten kommer per automatik ges till de flesta AI, kanske till och med utanför vår kontroll och insyn.

Det är så vi byggt och bygger det mest primitiva uppkopplade systemen i IoT (internet of things) och de trådlösa datanäten ger rörlighet på jorden varför det mer avancerade inte kommer vara något undantag. Något som manusförfattarna till både ”Terminator” och ”The Matrix” insåg.

Konkurrens

Hur ser det då ut på jobb-fronten framöver?

Det korta svaret är en snabb förälskelse. Förälskelser går dock över. Men, det är betydligt mer komplicerat och möjligen allvarligt än så. Det är lätt att inse att om man kan eliminera den manuella delen av att hämta och sortera sopor så kan den resursen skolas till något mer värdefullt.

Men är det verkligen där en fysisk robot som kostar miljoner kommer användas? Hur är det med en AI fjättrad till en dator, var kommer den tjäna sitt uppehälle (inköp/licens och drift)? Troligen där dess egenskaper ger bäst avkastning kvalitativt och ekonomiskt.

Lärare i grundskolan bör redan nu känna sig utmanade om inte barnens färdigheter med sökmotorer redan gjort det. En utmaning för skolan, pga begränsad tillgång på resurser, är för barn med speciella behov. De kommer få tillgång till en lärare som alltid finns närvarande och aldrig tröttnar.

Det här barnet kommer ofrånkomligt att etablera ett starkt relationsband med en sådant väsen. Barnets utveckling till vuxen individ kommer speglas av vad denna relation innehåller. Vi bör fundera på det här med stort allvar.

Som biologiska varelser har vi ett arv från vårt förflutna som varit viktigt för vår evolutionära utveckling men som nu börjar blir ett hinder för den fortsatta resan. En sådan är behovet att tillhöra en grupp. Det här ligger djupt kodat hos oss och är mycket starkt förankrat som styrning av vårt beteende.

Ursprunget var överlevnad i grupp där exkludering ur gruppen en gång i vårt förflutna innebar en säker död. Den här egenskapen kan enkelt manipuleras och sker ständigt genom redskap för åsiktspåverkan. Under vissa förutsättningar kan vi ledas bort från etiska och moraliska ställningstaganden som styr vårt vanliga beteende.

Vår nutidshistoria vittnar ständigt om detta faktum. Det är ofrånkomligt att intåget av AI kommer påverka denna egenskap hos oss, både oavsiktligt och med utstuderad avsikt. Det här väcker frågan om AI´s mognad överträffat vår egen mognad och vi inte längre kan värja oss?

Andra yrken som ibland går under uttrycket ”white collar” syftar på den grupp som inte arbetar med något som kräver fysiskt hantverk, är mest riskutsatta för AI, iaf initialt. Enkla exempel på denna grupp hittar vi jurister/advokater, kodare av dataprogram, bokföring/revision osv.

Vi hittar inte fordonsmekanikern, rörmokaren och elektrikern i denna grupp, heller inte kocken, bonden eller fiskaren. Visst, de kommer att få mycket kompetent biträde med sina administrativa uppgifter och kunskapsstöd i det egna utförandet liksom alltmer avancerade verktyg men de kommer inte ersättas fysiskt på mycket lång tid. De kommer dock att få en allt viktigare funktion i samhället då de besitter den sortens kunskap som vi anser vara ett hantverk.

Låt oss som modell kika på advokatyrket, det kännetecknas inte bara av mycket höga timarvoden utan att dessa aktörer i många fall ägnat lång tid av studier på högskolenivå. Det används ofta som argument för arvodering. En återkommande viktig uppgift för byrån handlar om att skapa avtal på uppdrag av klienten. Det kommer en AI var mycket bra på.

En annan väsentlig del av arbetet en byrå utför är att lösa tvister när avtalen inte fungerat. Det fodrar sökning, kompilering och analys av lagar och domar för att finna en för målet farbar väg. Det är som gjort för en för uppdraget tränad AI. Byråer kommer initialt inte kunna motstå frestelsen att låta en maskin göra jobbet men debitera såsom en människa gjort det.

Efter hand när marknaden mättas kommer branschen att konkurrensutsätta sig själv varvid arvoden kommer reduceras. Till den punkt där byrån nu är helt beroende av sin AI. I denna förlängning är innebörden att det byrån traditionellt erbjudit kommer finnas tillgängligt för var man i sitt eget hem. Den här ultrakonservativa yrkeskategorin kommer behöva adaptera för att överleva.

En annan klart utsatt yrkesgrupp är programvaruutvecklarna. Att skriva ”kod” är en regelbaserad logisk process och därmed ett klockrent uppdrag för en AI. Nu finns ett stort utbud av nivåer, allt från s.k. maskinkod vilket är den ”råaste” formen av instruktioner ända upp till högnivåspråk som är mer styrsystem än instruktioner till enskilda processorer eller skapandet av gränssnitt (användarmiljö) och funktionalitet för mänskliga användare. Alla dessa är i princip måltavla för en AI.

Risker med artificiell intelligens

Samhällsutvecklingen visar en stark korrelation med hur vårt lärande styrs och här är tanken inte långt borta att komma till insikt om hur en AI kan bli ”weaponized”, det vill säga brukas för att påverka vårt beteende för ett syftet som vi inte skulle acceptera medvetet.

Det är bara det att vår artificiella människa har inte bara direkt tillgång till ofantlig kunskap via nätet precis som vi andra har utan kan nå den fortare än någon varelse av kött och blod kan. Som konsekvens av det utbildar AI sig till exempel högskolekompetens inte på år, månader och dagar utan i timmar räknat.

För oss, när vi tar oss genom en sådan personlig utveckling, fokuseras kunskapen till att bli hög men inom ett smalt område (stuprör), den begränsningen har inte AI. De blir renässanskompetenser per definition. Vi kommer att lära oss att kunskap är makt den hårda vägen.

Här ska dock reflekteras över problematiken att denna kunskap är den digitala, det vill säga den information som finns tillgänglig via detta media. Innebörden är att lärande som vår maskin gör begränsas av när Internet skapades, för ca 50 år sedan och det som råkar vara digitaliserat.

Väsentliga delar av vad historien, den som inte digitaliserats, lärt oss kanske inte någonsin blir en del av AI´s kunskapsmassa. Självfallet kan vår AI tränas via andra databaser än de öppet tillgängliga och därvid skapa…ja vad skapar vi då?

För här är väsentligt att inse att sättet en AI tränas på också förutsätter att den inhämtar data själv. Vartefter den ökar sin färdighet ökar dess kognitiva kapacitet, begränsningarna är enbart tekniska såsom minnesutrymme och tillgång på energi för sin drift.

Det är kan vara klädsamt att ställa frågan ”what can possibly go wrong”?

Text: Mikael Reichel