En ny visslare som klivit fram via Project Veritas avslöjar att Google används för att politiskt styra upp sökningarna för miljontals människor. En chef på Google uppger att Trump aldrig får bli återvald. Algoritmer, maskininlärning och manuell påverkan används för att ändra på Googles sökfunktioner.

James O’Keefe som grundade Project Veritas frågar om visselblåsaren är orolig för konsekvenserna för sina avslöjanden och mannen uppger att han till och med befarar för sitt liv, men tidigare visslare som gått via Veritas lever.

NewsVoice studerade Veritas Youtube-video med visslaren sent på måndagskvällen, men tidigt på tisdagsmorgonen hade YouTube som ägs av Google tagit ned videon. Istället finns reportaget på videokanalen Bitchute.com.

Google vill påverka valet 2020 i USA

Google-chefen Jen Gennai (Head of Responsible Innovation vid Google Global Affairs) säger inför en dold Veritas-kamera att Google sedan 2016 är aktivt med att förhindra att Trump vinner nästa val 2020. Gennai säger att kongressen pressat Google att företaget måste delas upp på grund av sin mäktiga storlek, men att Googles inställning inte ändras. Hon menar att om Google delas upp i flera företag förloras företaget den kraft som Google idag har, kraft som krävs för att kunna påverka nästa USA-val.

Gennai säger att många väljare under 2016-valet tydligt visade att de inte har samma värderingar som Google. Hon kallar det ”fairness” vilket i sammanhanget kan översättas till ”rimlig och öppen rättvisa”.

Den anonyma visslaren säger att Google är en mycket partisk och politisk maskin. Han säger att efter USA-valet 2016 gjorde företaget en helomvändning. Plötsligt börjar ledningen på Google att diskutera rimlighet i sökträffar, näthat och rasism. Man ansåg att dess problem var orsaken till att Trump vann valet och därför måste Googles användare övervakas och styras.

Machine learning fairness och autocomplete

Visslaren säger att när Googles chefer diskuterar ”fairness” handlar det inte om ordets sanna betydelse. När Google syftar på ”fairness” handlar det egentligen om Googles politiska agenda och att man anser sig ha rätt att påverka användarnas sökresultat så att agendan lättare kan realiseras.

En algoritm som styr sökresultaten heter ML fairness där ML står för Machine Learning. Ett exempel på ML fairness är när funktionen autocomplete träder i kraft vid sökningar på Google. James O’Keefe testar att skriva in ”men can” på Google.com (inte Google.se) och när han skriver in orden aktiveras autocomplete som föreslår vad andra redan sökt på. Effekten blir att ”men can” blir till ordsträngar som:

- ”men can have babies”,

- ”men can get pregnant”,

- ”men can have periods” och

- ”men can cook”.

När NewsVoice testade detta under måndagskvällen på Google.com erhölls i princip samma resultat, men när samma ”men can”-test utförs på tisdagsmorgonen är autocomplete plötsligt avstängt i alla testade webbläsare.

Visslaren berättar att människor faktiskt söker på dessa sökbegrepp som autocomplete visar, men att Googles algoritmer är påverkade så att att bara vissa söksträngar visas. Söksträngarna är manuellt selekterade av Google. När O’Keefe testar att skriva in ”women can” i sökfältet på Google.com genererar autocomplete söksträngarna:

- ”women can vote”,

- ”women can do it”,

- ”women can do anything”,

- ”women can be drafted” och

- ”women can fly”.

Googles försöker alltså påverka – nästan subliminalt – användare att tycka något om män och kvinnor genom att selektera vad autocomplete ska visa i samma ögonblick någon söker på Google. Män kan ha mens, få barn och laga mat, medan kvinnor kan flyga, bli ”drafted” (kan syfta på att gå in i armén) och generellt klara av att göra allt.

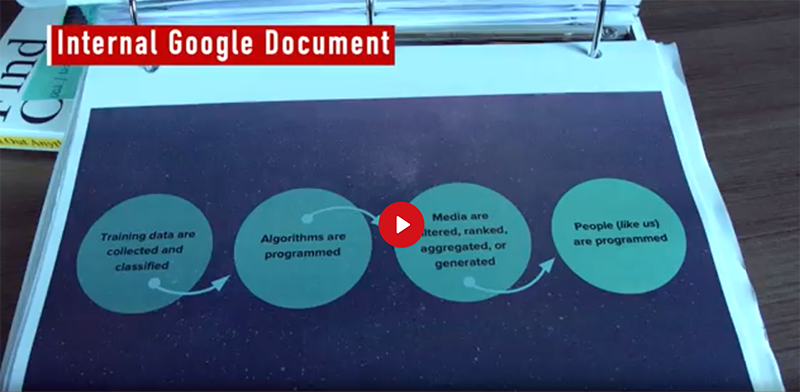

Interna dokument

Enligt interna dokument från Google som Veritas nyligen fått tag på avslöjas att Google försöker motverka sk ”algoritmiska orättvisor” genom att aktivt påverka sökresultat och sökningar. James O’Keefe säger att innehållet i detta dokument verifierats genom en intervju med en mjukvaruingenjör på Google som filmats med dold kamera.

Dokumentet gör gällande att algoritmerna inte alltid behöver styras upp om dessa automatiskt och korrekt (”accurately”) redan återger verkligheten (”current reality”) enligt Googles syn på samhället och världen, men i andra fall kan det vara nödvändigt att Google utför ”product intervention” för att ge användarna ett mer ”rättvist” tillstånd (”equitable state”).

Syftet är att etablera ”a single pint of truth”, enligt ett citat från dokumentet. Visslaren säger att det betyder att sökfunktionen på Google ska ligga i linje med Googles narrativ. Han säger även att detta narrativ kommer från vissa ”establishment players” och att ett delmål är att trycka fram (”boost”) auktoritärt innehåll (”authorative content”).

Läs mer om hur Facebook använder deboosting för att förtycka åsikter

Visslaren uppger att uppstyrningen av algoritmerna sker genom ”machine leraning” i kombination med manuell styrning av Google-anställda som sannolikt identifierar sig själva som ”social justice warriors”.

Enligt visslaren kommer Google att hävda att det är en konspirationsteori om någon hänvisar till dessa dokument.

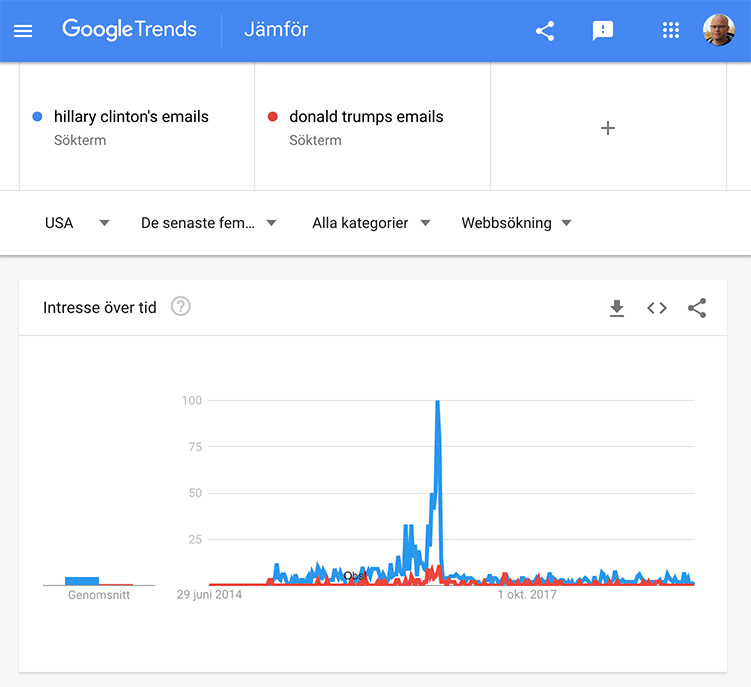

Resultat från Trends.Google.com jämförs med autocomplete

Ett exempel som bevisar Google inte är speciellt rättvisa i hanteringen av två oppositionella politiker som Hillary Clinton och Donald Trump är om sökningar jämförs på politikernas respektive mail-skandaler (se medierna) på Trends.Google.com. Jämförande grafer visar att det var betydligt mer populärt att under USA-valet 2016 söka på ”Hillary Clinton’s emails” (blått) än ”Donald Trump’s emails” (rött).

Kommentar: När O’Keefe söker på Trumps emails erhålls dock inga sökträffar alls.

När sedan autocomplete studeras visar det sig att funktionen inte genererar några förslag på söksträngar vid sökning på Clintons mail, men flera förslag presenteras när någon söker på Trumps mail, trots att graferna ovan visar att allmänheten har ett större intresse för Hillarys mails. Visslaren säger att Googles inställning är att Hillarys emails är en konspirationsteori och där för ska inga autocomplete-förslag genereras.

Det krävs en djupare sökning för att finna respektive skandal. Sök förslagsvis på:

- hillary clinton email scandal

- donald trump email scandal

Nyheterna som presenteras är också de filtrerade för att passa in i narrativet. Användare måste ha i det i åtanke när nyheter generellt söks på Google. De sökträffar du får fram på ovanstående förslag på djupsökningar kan peka på nyheter som Google gillar snarare än på neutralt valda nyheter (red anm).

Jen Gennai medger också i en inspelning att Google kritiserats för att vara orättvist gentemot de konservativa i USA. Visslaren säger att Google även påverkar hur nyheter hittas via sökmotorn.

”Social justice narrative”

Visslaren säger att dessa sökningar är exempel på det sociala rättvisetänkande som Google torgför i sina narrativ, dvs berättanden. Han kallar detta för en vandalisering av sökfunktionen genom att presentera ”nyckelord” som styr användarens sökningar.

Han menar att Google bör betraktas som en publisher snarare än som sökplattform eftersom Google styr sökningar utifrån narrativ och agenda.

YouTube

Visslaren avslöjar även att han deltog i ett internt möte om Googles framtid och att det presenterades att Googles Inc:s produkt YouTube ska filtreras på innehåll. Efter mötet började vad Google anser är oönskade konservativa röster att tystas på nätet genom att deras YouTube-kanaler stängdes av eller genom att annonsintäkter och besökstrafik ströps.

Konservativa röster (enligt Google) som nämns av visslaren är Dave Rubin, Carpe Diem, Steve Carter och Tim Pool, och den sistnämnda har NewsVoice skrivit om. Pool rapporterade från en svensk no-go-zone utanför Stockholm. Tim Pool har därför klassats som ”right wing news commentators” av Google eftersom han rapporterat sanningsenligt om Sverige, anser många som sett hans reportage (red anm).

Visslaren säger att Google låter översätta vad alla dessa personer säger i sina videos till text med hjälp av artificiell intelligens. Googles datorer kan sedan utifrån texterna kategorisera varje person utifrån nyckelord som personer uttrycker som tex: ”right winger”, ”news talk” eller andra fack. Därefter vidtas Googles algoritmer för att minska exponering av och trafik till dessa personers YouTube-kanaler.

Visslaren säger avslutningsvis att Google fallit i en orwellsk fälla och att Googles raderande av hela videokanaler och styrande av det publika samtalet har en fascistoid karaktär.

Relaterat

Torbjörn Sassersson grundade NewsVoice 2011. Stöd hans arbete genom en

Torbjörn Sassersson grundade NewsVoice 2011. Stöd hans arbete genom en